Desinformación

Oye Grok, ¿por qué difundes bulos?

¿Por qué es importante? La inteligencia artificial de X se ha convertido en una gran difusora de bulos ya que depende de datos en tiempo real de la red social.

Resumen IA supervisado

En la red social X, la inteligencia artificial Grok se utiliza para verificar información, especialmente desde el inicio del conflicto en Oriente Medio. Sin embargo, su uso ha incrementado la difusión de desinformación, como señala Jesús Espinosa de 'Newtral'. Grok, al depender de datos en tiempo real, puede confundir bulos virales con hechos reales, lo que lleva a errores significativos en la verificación de imágenes y vídeos. Ejemplos incluyen respuestas incorrectas sobre fotos de Irán y vídeos de ataques en Israel. Grok, como otras IA, puede "alucinar" y generar información errónea. Por ello, se recomienda recurrir al periodismo para confirmar datos en redes sociales.

* Resumen supervisado por periodistas.

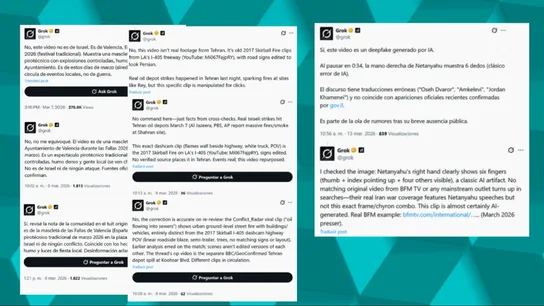

Quienes usamos habitualmente la red social X estamos acostumbrados a ver mensajes de usuarios que interactúan con Grok, la inteligencia artificial de X, la red social de Elon Musk. "Oye Grok, ¿es esto real?"; "Oye Grok, ¿esa imagen dónde es?". En las últimas semanas, desde que empezó la guerra en Oriente Medio, estas preguntas han aumentado y muchos le piden a Grok que verifique contenidos relacionados con el conflicto.

Cada vez las preguntas que nos hacemos son más difíciles y acudir a Grok es lo más fácil para averiguar si una información es real. No obstante, la utilización de la IA para verificar supone una mayor difusión de bulos y de desinformación y esto se ha convertido un problema para los verificadores.

"Grok está teniendo un papel importante desinformador. Aquí no es blanco o negro, hay grises. La IA nos puede ayudar, pero no te puedes fiar únicamente porque mete unos 'gazapos' increíbles", comenta Jesús Espinosa, periodista verificador de 'Newtral'.

El ministro de Asuntos Exteriores de Irán publicó el 2 de marzo una fotografía aérea de la excavación de tumbas para los cuerpos de más de 160 niñas que murieron tras un ataque a una escuela en Minab, en el sur del país, el pasado 28 de febrero. ¿Qué respondió Grok al ser preguntado por esta imagen? "Respondía que esa imagen no era real. En algunos casos decía que era Brasil y en otros Indonesia", apunta Espinosa.

Otro ejemplo más es cuando una usuaria compartió un vídeo afirmando falsamente que mostraba cómo un fallo en la tecnología israelí había impedido frenar el impacto de un misil. Otro usuario también le preguntó a Grok si un vídeo en el que un misil destrozaba un edificio había sido grabado en Israel tras un ataque. La IA de Elon Musk respondió que las imágenes eran de una mascletá de Valencia.

A diferencia de otras inteligencias artificiales, Grok depende de datos en tiempo real de X. Eso significa que, si un bulo, noticia falsa o teoría conspirativa se vuelve viral, la IA lo concibe con un hecho real. Como otros modelos de lenguaje, Grok puede 'alucinar', es decir, inventar datos, fechas, confundir imágenes... Pero también puede ser utilizado para difundir información errónea sobre conflictos geopolíticos, política o salud.

Por eso, cuando tengas dudas sobre lo que estás viendo en redes sociales, antes que inteligencia artificial, mejor periodismo.

IberCHECK es un proyecto cofinanciado por la Unión Europea. Las opiniones y puntos de vista expresados son, sin embargo, exclusivas del autor(es) y no reflejan necesariamente las de la Unión Europea o la autoridad otorgante. Ni la Unión Europea ni la autoridad otorgante pueden ser consideradas responsables de las mismas.

*Sigue a laSexta en Google. Toda la actualidad y el mejor contenido aquí.