Efectos secundarios

Los problemas de la IA en la guerra: su uso por parte de EEUU le hace caer en su propia trampa

¿Por qué es importante? Estados Unidos, a través de la empresa Palantir, estaría utilizando la inteligencia artificial para alcanzar 2.000 objetivos en territorio iraní, pero entre ellos estaría la escuela de niñas donde murieron 160 menores.

Resumen IA supervisado

En 2018, los trabajadores de Google se opusieron al desarrollo de inteligencia artificial con fines bélicos para el Pentágono, lo que llevó a la empresa a abandonar el proyecto. Palantir tomó su lugar, optimizando el análisis de datos para identificar objetivos, permitiendo a Estados Unidos alcanzar 2.000 objetivos en Irán en cuatro días. Sin embargo, la IA también ha facilitado ataques controvertidos, como el cometido contra una escuela infantil. Enrique Dans señala que el activismo actual es más difícil debido al apoyo de empresas tecnológicas a políticas de Trump. Juan Antonio Muñoz Gallego destaca que la IA depende de recursos físicos, cuya disponibilidad podría verse afectada por conflictos en el Golfo Pérsico.

* Resumen supervisado por periodistas.

Corría el año 2018 cuando los trabajadores de Google supieron que su empresa estaba desarrollando para el Pentágono una inteligencia artificial con fines bélicos. Su respuesta fue clara: se plantaron.

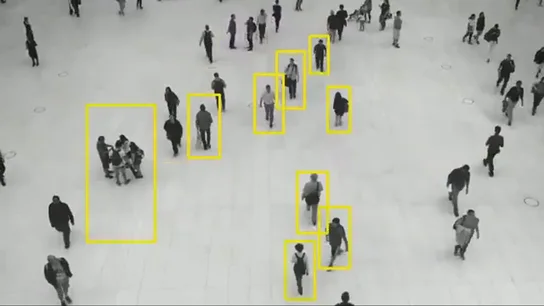

Google tuvo que apartarse del proyecto, pero apareció otra empresa, Palantir, que ocupó su lugar para hacer más eficiente el análisis de datos para identificar objetivos. Ocho años después esa aplicación ha permitido a Estados Unidos alcanzar 2.000 objetivos en territorio iraní en apenas cuatro días.

"El activismo que mostraron los trabajadores de Google contra la colaboración con el Pentágono, hoy en día es mucho más difícil de plantear porque ahora la gran mayoría de las empresas tecnológicas han participado de manera entusiasta en la proclamación de Donald Trump", explica Enrique Dans, profesor de Innovación en IE University.

Sin embargo, entre esos miles de ataques favorecidos por la IA habría estado también el cometido contra una escuela infantil asesinando a más de 160 niñas.

Y ese no es el único riesgo: "Lo que se llaman las estrategias de decapitación, por ejemplo, decapitar la cúpula militar de un país; Pueden ser efectivamente mucho más eficientes mediante herramientas de inteligencia artificial, pero pueden generar efectos secundarios como que, por ejemplo, el país se radicaliza mucho más".

Pero podríamos decir que, paradójicamente, la inteligencia artificial ha caído en su propia trampa. "Curiosamente la IA que queremos que crezca se ve penalizada por una guerra en la que se usa la inteligencia artificial, no solo para los drones, también submarinos que se mueven de forma autónoma, barcos que se mueven de forma autónoma", comenta Juan Antonio Muñoz Gallego, socio de Skiller Academy.

Una industria que depende mucho de los suministros. "Muchas veces pensamos en inteligencia artificial como algo abstracto, como eso que está en la nube, pero en realidad hablamos de chips, hablamos de máquinas, centros de datos, hablamos de gas. Si eso no fluye a través del estrecho de Ormuz, posiblemente esa factura energética se incrementará", añade Muñoz Gallego recordando que muchos de los productos que se utilizan para que funcione se producen en un Golfo Pérsico ahora bloqueado.

En un año en el que Estados Unidos ha invertido más dinero que nunca en la inteligencia artificial.

*Sigue a laSexta en Google. Toda la actualidad y el mejor contenido aquí.