ÉTICA PARA ROBOTS

La humanidad se da un siglo para fijar las reglas que deberán seguir las máquinas

A través de coches autónomos, sistemas que hablan con nosotros o robots diseñados para hacernos la vida más fácil, la inteligencia artificial hace cada vez más acto de presencia a nuestro alrededor. Ahora, gigantes de la talla de Facebook, Alphabet, Amazon, Microsoft e IBM se han unido para marcar el camino ético en el proceso de creación de estos sistemas, que plantean problemas éticos como la pérdida de puestos de trabajo o la falta de privacidad.

Publicidad

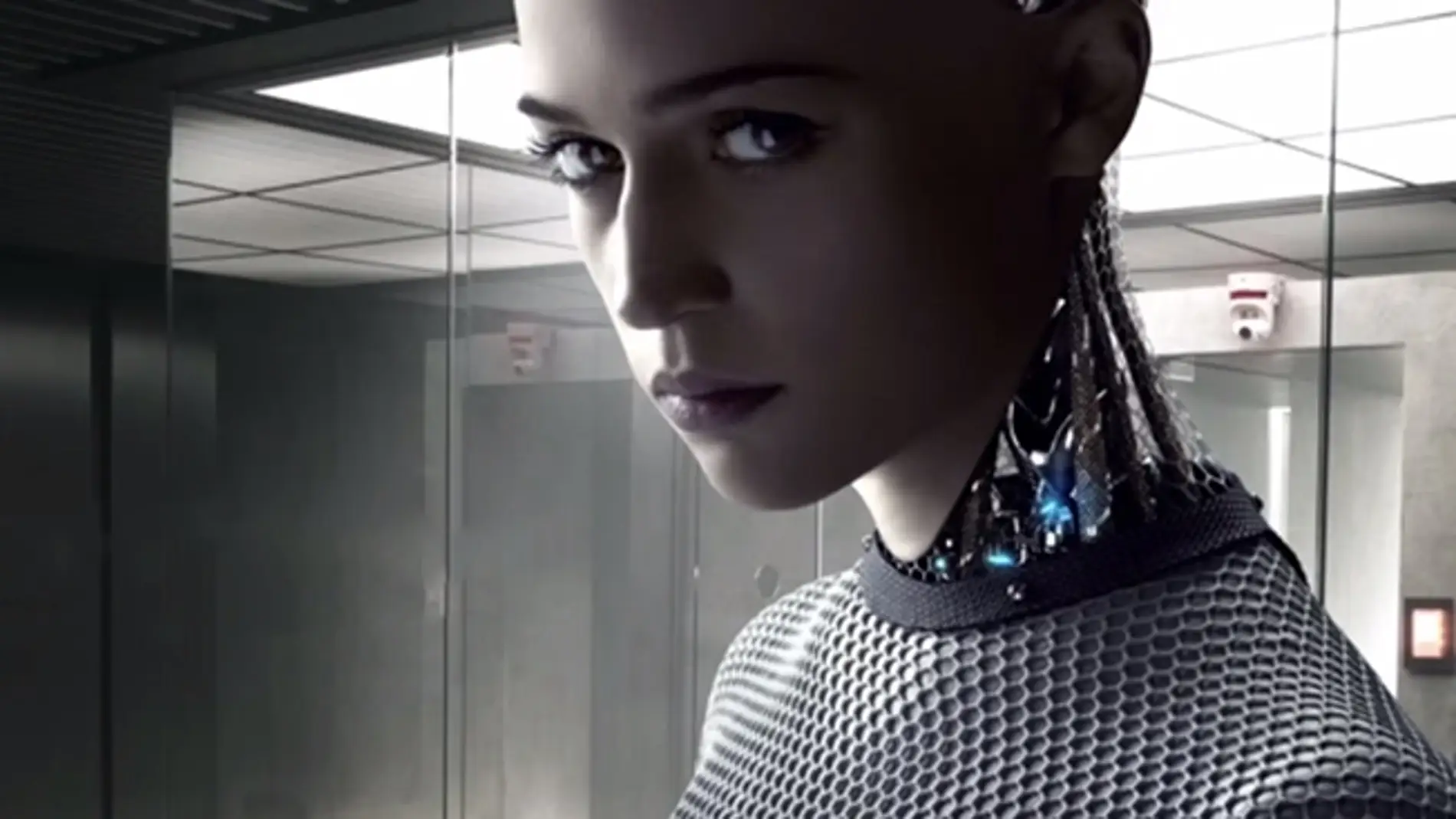

Los libros y películas de la ciencia ficción nos han enseñado a temer ese futuro en el que los robots tengan suficiente inteligencia como para alzarse contra los seres humanos. Por el momento, la ciencia no ha conseguido desarrollar una máquina tan avanzada y este presagio se antoja imposible, pero actualmente ya contamos con otras formas de inteligencia artificial que, aunque no tengan el potencial de destruir el mundo, sí han creado nuevos escenarios que despiertan preocupaciones justificadas.

Así, asusta que las máquinas quiten trabajo a las personas, o que los vehículos autónomos tomen decisiones cuando transportan a la gente.

La industria se encuentra sumergida en una carrera por evolucionar y conseguir el sistema más avanzado. A pesar de esta dura competición, cinco grandes compañías se han puesto de acuerdo para unir fuerzas y reflexionar. Amazon, Facebook, IBM, Microsoft y Alphabet, la antes conocida como Google, planean estipular unas normas éticas con las que guiar a los creadores de las máquinas de inteligencia artificial, según publica ‘The New York Times’. La intención es que todas las máquinas busquen beneficiar a la sociedad y ninguna haga daño al ser humano.

Se espera que las tecnológicas anuncien la creación del grupo este mismo mes, aunque aún no han revelado su nombre ni han anunciado si se incorporarán más actores. Por ahora, Google DeepMind, dedicada a la inteligencia artificial, ha pedido participar por separado de Alphabet.

Uno de los actores en esta singular cruzada colaborativa es Eric Horvitz, investigador de Microsoft y expresidente de la Asociación para el Avance de la Inteligencia Artificial. Su participación no es casual, y es que este experto en computación es el creador del proyecto 'One Hundred Year Study on Artificial Intelligence' ("Cien años de estudio de la Inteligencia Aritificial", según su traducción al castellano), que tiene como objetivo investigar y anticipar cómo pueden afectar a la población los efectos de la inteligencia artificial.

Junto a otros prestigiosos científicos, y con la colaboración de la Universidad de Stanford, el proyecto traza un plan a muy largo plazo, nada menos que un siglo, aunque cada cinco años, se publicará un estudio sobre el impacto de las máquinas en la sociedad.

“La inteligencia artificial es una de las promesas más profundas de la ciencia, y afectará a todos los aspectos de la vida humana”, afirma John Hennessy, presidente de la Universidad de Standford al respecto.

Las desventajas de la innovación

El grupo de expertos analiza la influencia de la inteligencia artificial en ocho categorías que van de la salud, la seguridad y la educación, a los robots de servicio, el sistema democrático y los ciberdelincuentes que se aprovechan de los nuevos sistemas.

Uno de los temas más candentes que trata este grupo de investigación es la falta de intimidad y la escasa protección de datos que a veces conlleva esta tecnología. Los científicos de Stanford recuerdan que “al mismo tiempo que se fomenta la innovación en las políticas y procesos, se deben abordar las implicaciones éticas de privacidad y seguridad”.

Como ejemplo, el flamante WhatsApp de Google, Allo, ha traído consigo toda serie de críticas por la ausencia de privacidad. La app de mensajería instantánea consigue ser inteligente aprendiendo del usuario y utilizando toda la información que Google tiene de él para predecir sus necesidades y ofrecer respuestas y recomendaciones automáticas. Así, el precio que tiene que pagar el usuario a cambio de que un ‘software’ piense por él es su intimidad, ya que la aplicación almacena todos los mensajes para poder aprender de ellos.

Otra de las preocupaciones que ha traído consigo la inteligencia artificial y que aborda ya este centenario proyecto de investigación es la probable pérdida de empleos. “Hasta la fecha, las tecnologías digitales han afectado a los trabajadores cualificados a un nivel intermedio, como los que trabajan en agencias de viajes, y no a empleos de muy baja cualificación o muy alta”, afirma el estudio.

Así, y aunque los expertos creen que es muy improbable que las máquinas vayan a reemplazar el trabajo de las personas a un nivel masivo, matizan que es muy difícil dilucidar cómo evolucionará la situación. No obstante, señalan que, en un futuro no muy lejano, una gran variedad de determinados puestos pueden verse afectados, desde radiólogos a conductores de camiones o jardineros.

“La inteligencia artificial va a invadir poco a poco casi todos los sectores de empleo, lo que requiere un desplazamiento de la mano de obra humana que los ordenadores son capaces de llevar a cabo”, concluye el informe.

El origen de todo

La semilla del proyecto de Stanford se plantó en 2009, cuando Horvitz organizó una conferencia para que los investigadores debatiesen sobre la temática y sintió la necesidad de que el debate no se estancase ahí. De hecho, el investigador de Microsoft no es el único que ha planteado la creación de unas normas éticas que deberían seguir las máquinas. En 2015, los mismísimos Elon Musk, Stephen Hawking, los fundadores de Google DeepMind y una docena de científicos más firmaron una carta abierta en la que exigían una investigación profunda que plantease la mejor forma de garantizar que la inteligencia artificial siga siendo una herramienta inofensiva y a disposición de la humanidad.

Lo que sí queda claro, antes de que el centenario estudio llegue a su fin, es que la industria se está moviendo para que sus avances convivan en armonía con la sociedad actual. Por ahora, los autores del estudio no piden explícitamente que no haya una regulación internacional: prefieren que se cree un marco de autovigilancia en el que sean ellos mismos los que dispongan el camino correcto a seguir. Las normas éticas para la inteligencia artificial se están fraguando para evitar un futuro apocalíptico.

Publicidad